大数据技术常用的数据处理方式有哪些?

1、大数据技术常用的数据处理方式,有传统的ETL工具利用多线程处理文件的方式;有写MapReduce,有利用Hive结合其自定义函数,也可以利用Spark进行数据清洗等,每种方式都有各自的使用场景。

2、大数据常用的数据处理方式主要包括以下几种: 批量处理(Bulk Processing): 批量处理是一种在大量数据上执行某项操作的策略,通常在数据被收集到一个特定的时间点后进行。这种方式的特点是效率高,但响应时间较长。

3、批处理模式(Batch Processing):将大量数据分成若干小批次进行处理,通常是非实时的、离线的方式进行计算,用途包括离线数据分析、离线数据挖掘等。

4、离线处理 离线处理方式已经相当成熟,它适用于量庞大且较长时间保存的数据。在离线处理过程中,大量数据可以进行批量运算,使得我们的查询能够快速响应得到结果。

5、数据挖掘算法 可视化是给人看的,数据挖掘就是给机器看的。集群、分割、孤立点分析还有其他的算法让我们深入数据内部,挖掘价值。这些算法不仅要处理大数据的量,也要处理大数据的速度。

6、数据转换就是将数据进行转换或归并,从而构成一个适合数据处理的描述形式。常用的转换策略如下。规格化处理。

大数据处理必备的十大工具!

1、常见的大数据处理工具有Hadoop、Spark、Apache Flink、Kafka和Storm等。 **Hadoop**:Hadoop是一个分布式计算框架,它允许用户存储和处理大规模数据集。

2、Storm Storm是自由的开源软件,一个分布式的、容错的实时计算系统。Storm可以非常可靠的处理庞大的数据流,用于处理Hadoop的批量数据。Storm很简单,支持许多种编程语言,使用起来非常有趣。

3、Python,是一种面向对象、解释型计算机程序设计语言。Python语法简洁而清晰,具有丰富和强大的类库。它常被昵称为胶水语言,能够把用其他语言制作的各种模块(尤其是C/C)很轻松地联结在一起。

4、Apache Spark 是最好、最强大的开源大数据分析工具之一。借助其数据处理框架,它可以处理大量数据集。通过结合或其他分布式计算工具,在多台计算机上分发数据处理任务非常容易。

etl数据分析工具有哪些?

1、datax是支持分布式部署的数据传输工具,具有良好的稳定性,在大规模数据传输过程中可以提高效率和稳定性。etlcloud是一个基于Web的ETL工具,提供多种数据集成和转换功能,支持不同数据源的连接和转换操作,且运行速度快。

2、IBM公司的商业软件,最专业的ETL工具,但同时价格不菲,适合大规模的ETL应用。使用难度:★★★ Informatica 商业软件,相当专业的ETL工具。价格上比Datastage便宜一点,也适合大规模的ETL应用。

3、专业的大数据分析工具 FineReport FineReport是一款纯Java编写的、集数据展示(报表)和数据录入(表单)功能于一身的企业级web报表工具,只需要简单的拖拽操作便可以设计复杂的中国式报表,搭建数据决策分析系统。

4、以前大数据分析会用到多种工具,比如数仓工具、数据建模工具、BI工具等等。现在的大数据分析平台,都是全能型数据分析平台,一个平台搞定所有。

5、数据分析的工具千万种,综合起来万变不离其宗。无非是数据获取、数据存储、数据管理、数据计算、数据分析、数据展示等几个方面。而SAS、R、SPSS、python、excel是被提到频率最高的数据分析工具。

大数据etl工具有哪些

Pentaho的工具可以连接到NoSQL数据库,例如MongoDB和Cassandra。PeterWayner指出,PentahoData(一个更有趣的图形编程界面工具)有很多内置模块,你可以把它们拖放到一个图片上,然后将它们连接起来。

datax是支持分布式部署的数据传输工具,具有良好的稳定性,在大规模数据传输过程中可以提高效率和稳定性。etlcloud是一个基于Web的ETL工具,提供多种数据集成和转换功能,支持不同数据源的连接和转换操作,且运行速度快。

Datastage、Informatica、Kettle三个ETL工具的特点和差异介绍:操作 这三种ETL工具都是属于比较简单易用的,主要看开发人员对于工具的熟练程度。

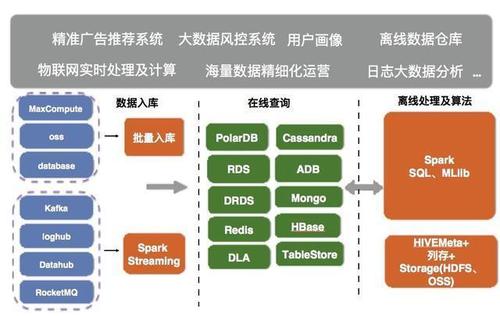

离线搜集工具:ETL 在数据仓库的语境下,ETL基本上便是数据搜集的代表,包括数据的提取(Extract)、转换(Transform)和加载(Load)。

Apache Hive Hive是一个建立在Hadoop上的开源数据仓库基础设施,通过Hive可以很容易的进行数据的ETL,对数据进行结构化处理,并对Hadoop上大数据文件进行查询和处理等。

几种 ETL 工具的比较(DataPipeline,Kettle,Talend,Informatica等)四种工具的比较主要从以下几方面进行比对:成本:软件成本包括多方面,主要包括软件产品, 售前培训, 售后咨询, 技术支持等。

大数据处理必备的十大工具

1、常见的大数据处理工具有Hadoop、Spark、Apache Flink、Kafka和Storm等。 **Hadoop**:Hadoop是一个分布式计算框架,它允许用户存储和处理大规模数据集。

2、OpenRefine(过去的Google Refine)是处理杂乱数据的强有力工具,可用于清理、转换、链接数据集。借助其分组功能,用户可以轻松地对数据进行规范化。

3、在大数据处理分析过程中常用的六大工具:Hadoop Hadoop是一个能够对大量数据进行分布式处理的软件框架。但是Hadoop是以一种可靠、高效、可伸缩的方式进行处理的。

4、大数据分析工具好用的有以下几个,分别是Excel、BI工具、Python、Smartbi、Bokeh、Storm、Plotly等。Excel Excel可以称得上是最全能的数据分析工具之一,包括表格制作、数据透视表、VBA等等功能,保证人们能够按照需求进行分析。

5、R是一套完整的数据处理、计算和制图软件系统。它可以提供一些集成的统计工具,但更大量的是它提供各种数学计算、统计计算的函数,从而使使用者能灵活机动的进行数据分析,甚至创造出符合需要的新的统计计算方法。

6、数据挖掘的工具 在进行数据分析工作的时候,我们需要数据挖掘,而对于数据挖掘来说,由于数据挖掘在大数据行业中的重要地位,所以使用的软件工具更加强调机器学习,常用的软件工具就是SPSS Modeler。